Cómo predictivo análisis de redes neuronales trabajo

Un complejo algoritmo utilizado para el análisis predictivo, la red neuronal, está inspirada biológicamente por la estructura del cerebro humano. Una red neuronal proporciona un modelo muy simple en comparación con el cerebro humano, pero funciona bastante bien para nuestros propósitos.

Ampliamente utilizado para la clasificación de los datos, de los nervios pasado redes de procesos y datos actuales para estimar valores futuros - descubrir correlaciones complejas ocultos en los datos - de una manera análoga a la empleada por el cerebro humano.

Las redes neuronales se pueden utilizar para hacer predicciones sobre series temporales de datos tales como datos meteorológicos. Una red neural puede ser diseñado para detectar patrón en datos de entrada y producir una salida libre de ruido.

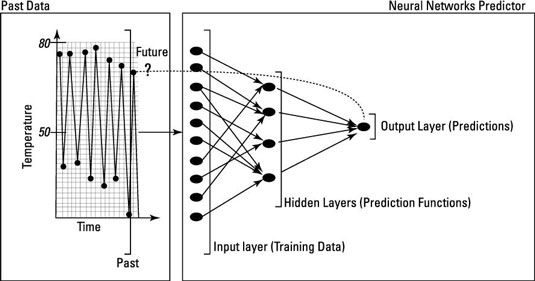

La estructura de un algoritmo de red neuronal tiene tres capas:

La capa de entrada alimenta valores de los datos anteriores a la siguiente capa (oculta). Los círculos negros representan nodos de la red neuronal.

La capa oculta encapsula varias funciones complejas que crean predictors- menudo esas funciones están ocultas para el usuario. Un conjunto de nodos (círculos negros) en la capa oculta representa funciones matemáticas que modifican la entrada de datos de estas funciones se llaman neuronas.

La capa de salida recoge las predicciones hechas en la capa oculta y produce el resultado final: la predicción del modelo.

He aquí un vistazo más de cerca cómo una red neuronal puede producir una salida predicha a partir de los datos de entrada. La capa oculta es el componente clave de una red neuronal debido a las neuronas que contenga- trabajan juntos para hacer los grandes cálculos y producir la salida.

Cada neurona toma un conjunto de entrada de valores- cada uno está asociado con una peso (más sobre esto en un momento) y un valor numérico conocido como parcialidad. La salida de cada neurona es una función de la salida de la suma ponderada de cada entrada más el sesgo.

La mayoría de las redes neuronales usan funciones matemáticas para activar las neuronas. LA función en matemáticas es una relación entre un conjunto de entradas y un conjunto de salidas, con la regla de que cada entrada corresponde a una salida.

Por ejemplo, considere la función negativa donde un número entero puede ser una entrada y la salida es su equivalente negativo. En esencia, una función en matemáticas funciona como un cuadro negro que toma una entrada y produce una salida.

Las neuronas en una red neuronal pueden utilizar sigmoideo funciones para que coincida con las entradas a las salidas. Cuando se utiliza de esa manera, una función sigmoide se llama función logística y su fórmula es la siguiente:

F(entrada) = 1 / (1 + esalida)

Aquí F es el función de activación que activa la neurona, y e es una constante matemática ampliamente utilizado que tiene el valor aproximado de 2.718.

Usted podría preguntarse por qué tal función se utiliza en las neuronas. Bueno, la mayoría de las funciones sigmoideas tienen derivados que son positivas y fácil de calcular. Son continua, puede servir como tipos de funciones de suavizado, y también están limitadas funciones.

Esta combinación de características, única de funciones sigmoides, es vital para el funcionamiento de un algoritmo de red neuronal - especialmente cuando un cálculo derivado - es necesario - como el peso asociado a cada entrada de una neurona.

El peso de cada neurona es un valor numérico que se puede derivar usando entrenamiento supervisado o no supervisado de entrenamiento como la agrupación de datos.

En el caso de entrenamiento supervisado, los pesos se derivan por la alimentación de las entradas y salidas de muestra para el algoritmo hasta que los pesos están sintonizado (es decir, hay un partido casi perfecto entre entradas y salidas).

En el caso de la formación sin supervisión, la red neural solamente se presenta con insumos- el algoritmo genera sus correspondientes salidas. Cuando los algoritmos se presentan con entradas nuevas, pero-similar y el algoritmo produce nuevas salidas que son similares a los resultados anteriores, a continuación, los pesos de las neuronas se han sintonizado.

Las redes neuronales tienden a tener una alta precisión incluso si los datos tienen una cantidad significativa de ruido. Esa es una ventaja- importante cuando la capa oculta todavía puede descubrir relaciones en los datos a pesar de ruido, que puede ser capaz de utilizar los datos de otro tipo, no utilizables.

Una de las desventajas de los algoritmos neuronales en la red es que la precisión de la predicción puede ser válida sólo dentro del período de tiempo durante el cual se reunieron los datos de entrenamiento.